2026.05.12

レポート

AI ガバナンス・セキュリティと政策動向

AIリスク 「技術課題」から「経営の意思決定課題」へ転換

マサチューセッツ工科大学サイバー・AIセキュリティマネジメントコンソーシアム(CAMS) 副統括責任者

慶應義塾大学 特任教授

ミュンヘン工科大学AI倫理研究所客員教授 藤末 健三氏

世界のAIパワー比較

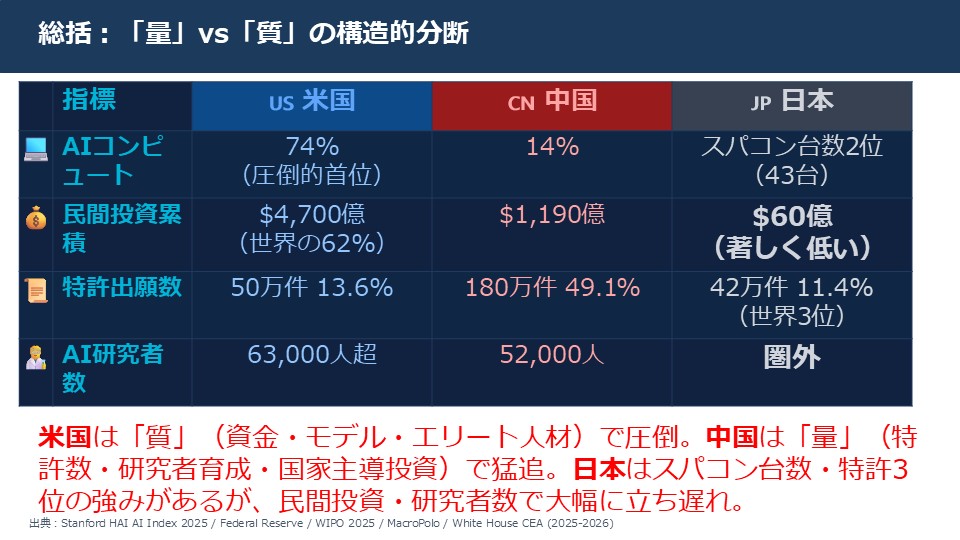

現在AIは米国と中国が覇権国家となっています。以下、サーバー市場、投資、特許、人材別に各国の動向を比較し紹介します。(図1)

(1)AIサーバー市場

一般的なサーバー市場については北米が4割、アジア圏が3割、EUが2割という状況ですが、AIサーバーに絞ると北米が74%を占有しています。中国は米国からの輸出規制により5年前の25%から現在は15%に低下しています。ただし、世界地図上でサーバー市場を分析すると、米・中国間でAIサーバーを世界各地にどれだけ作るかの競争が行われていることがオックスフォードの研究機関の調査で把握できます。

(2)AI研究開発投資額

AI研究開発投資額を比較すると、米国が4,700億ドル、中国が主に国家主導で1,190億ドルを投じているのに対し、日本は60億ドルにとどまっています。AIについて議論する際には、米国や中国がAIの研究開発に莫大な資金を投入している、ということを留意しておかなければなりません。

こうした状況の中、日本はAIビジネスやスタートアップの議論において海外動向を把握していなかったり、AIのビジネス化やセキュリティマネジメントへの取り組みが遅れてしまうのではないか、と懸念しており、よりグローバルに、より幅広く動向を把握していく必要があると思っています。

(3)AI関連特許

AI特許シェアについては中国が約5割とトップを占め、米国14%、日本11%となっています。ただし、中国は国内特許がほとんどのため、特許比較はあまり重視しておらず、先に紹介したAI研究開発投資額の比較の方を重視しています。

(4)AI研究者数・トップ人材シェア

AI研究者数を比較しても米国が圧倒的に多く、次に中国と続きますが、中国生まれの研究者が米国から中国に戻ったり、新たなAIアルゴリズムが開発されるなど、今後は中国のAI研究者が多くを占めていくだろうと予想しています。また、インドも急激な勢いで研究者の育成に取り組んでいます。

図1.世界のAIパワー比較

AI覇権の民主化:国際社会への提言

(1)提言

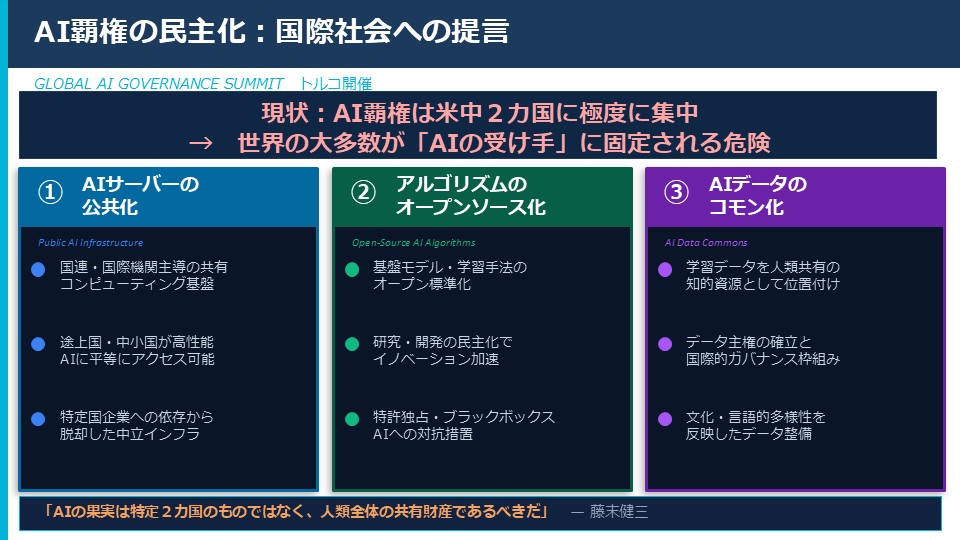

トルコで開催されたGLOBAL AI GOVERNANCE SUMMITでは、米国や中国がAI覇権を握る状況下において、以下の3点が提言されました。(図2)

- サーバーの公共化(公共化としてのAI)

- アルゴリズムのオープンソース化

- AIデータのコモン化(共有化)

AIデータのコモン化の例として、インドでは患者データが安価で買われています。AIで重要とされる正確なデータ、特にバイオデータが資本で集められてしまうと、お金のない国民がAI診断を受けられないような状況になりかねません。そこでAIのデータ共有化により世界中の人たちがAIの恩恵を受けられるようにしよう、と提案されました。

今後、日本でも同様の議論がされていくと思われますが、AIサービスが普及していく中、潤沢な資金を持つ企業や個人がAIを独占するような時代の到来に対し、どう対処していくか、がこれから求められることだと思います。

図2.AI覇権の民主化:国際社会への提言

(2)法規制

EUでは人権保護やプライバシー保護をメインとしたEU AI Actが成立して2年が経ちました。日本でもこの法律に準じたルールを作ろうとしています。一方米国では、GoogleやAmazonなどでAIの判断結果による人種差別や性差別などのトラブルが発生しており、法規制よりも民間企業によるガイドラインの策定等で規制が行われています。

もう一つ、議論が必要視されているのが兵器としてのAI規制です。AIを利用した兵器をどう規制するか国連で議論されていますが、なかなか進まない状況です。

AI規制について、EUは人権を侵害せずにどう活用するか、米国は産業・ビジネス成長に、中国は国家の安全保障・管理にAIをどう活用するか、とそれぞれ求める方向性が異なるため、世界で統合されたAI管理の議論はなかなか進まないのではないか、と感じています。

AI時代のセキュリティ

(1)AIそのものを守る

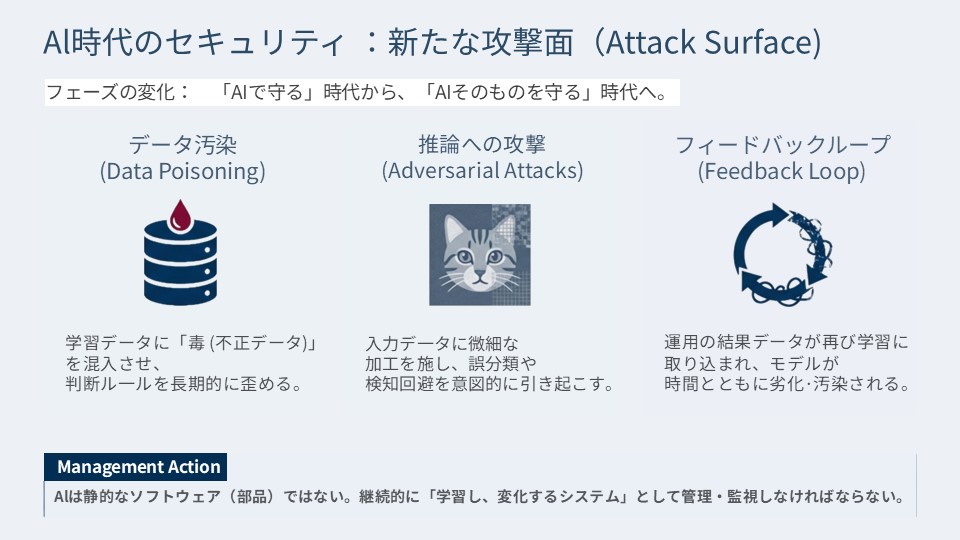

AI時代のセキュリティは「AIで守る」段階から「AIそのものを守る」段階へと移行してきています。

AIに汚染されたデータを学習させることで判断を狂わせたり、アルゴリズムへの細工、AIのフィードバックループを狂わせる、誤った議論に誘導してしまうなどがあります。AIの回転スピードが速すぎるために、マルウェアや悪い情報を埋め込めばどんどん悪い方に進んでしまうのがAIの特徴だと思います。(図3)

図3.AI時代のセキュリティ:新たな攻撃面(Attack Surface)

(2)セキュリティ知識の共有

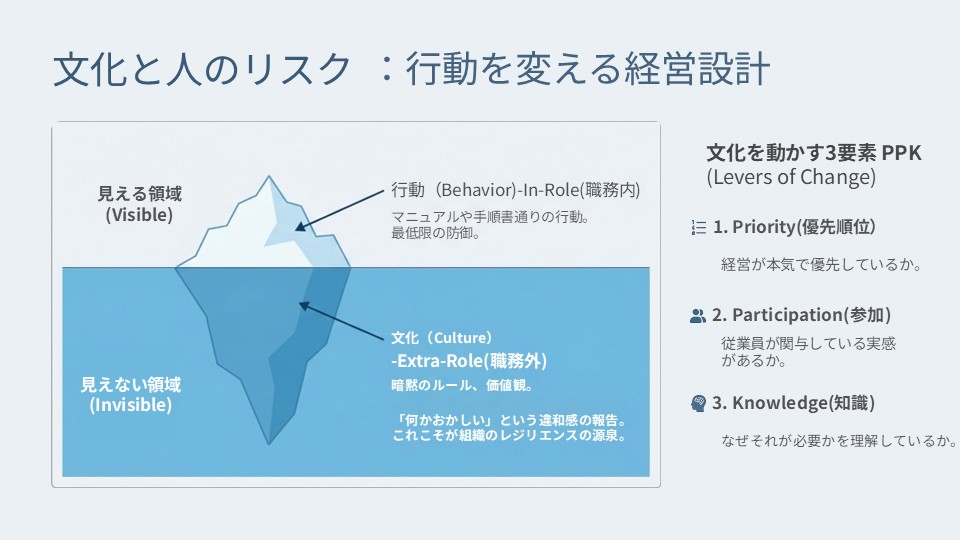

AIセキュリティもサイバーセキュリティと同様ですが、日本はテクノロジー側に寄りがちですが、目に見える領域だけでなく、根幹にある文化、社員のセキュリティに対する意識や、経営者がセキュリティを理解し、トラブル発生時に即座に対応、優先順位を的確に判断でき、社員が主体的に参加することが重要であり、その前提としてセキュリティに対する知識を共有することが重要となります。(図4)

図4.文化と人のリスク:行動を変える経営設計

(3)成熟度モデルとリスクの定量化

これまでのセキュリティは「問題を起こしてはいけない」「当事者の責任」でしたが、昨今ではAI、サイバーともに攻撃や問題発生が当たり前になっており、インシデント発生後いかにレジリエンスを高めて復活させるか、原因究明するか、などの評価基準が成熟度モデルにより変わります。

また、リスクを定量化し、技術指標そのままではなく、損失や費用がいくらになるか、といった経営指標に置き換えることが重要です。

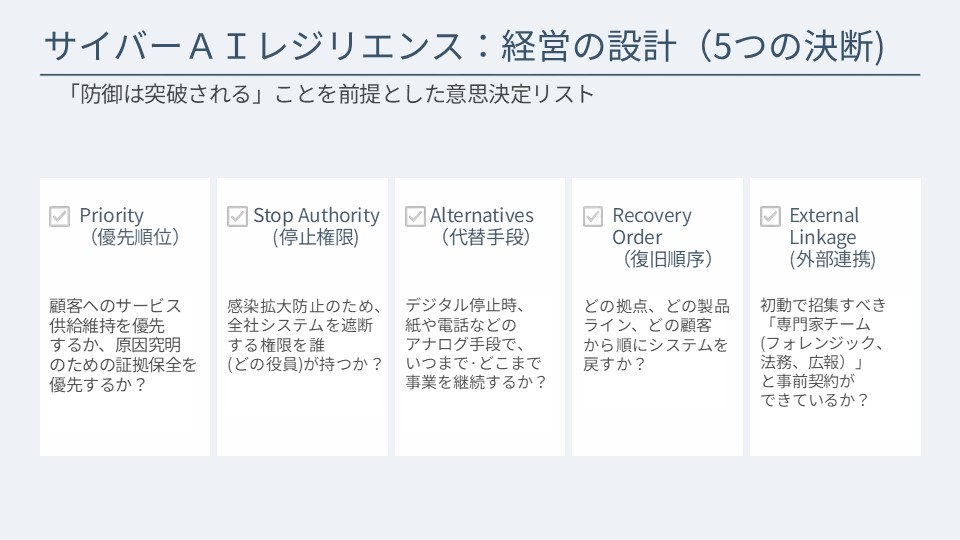

(4)サイバーAIレジリエンス:経営の設計(5つの決断)

経営者には、インシデント発生後、①優先順位、②停止権限、③代替手段、④復旧順序、⑤外部連携の判断が求められます。今後インシデントが発生した際に、経営者がどう対応するかが重要になります。(図5)

図5.サイバーAIレジリエンス:経営の設計(五つの決断)

(5)AIセキュリティの課題

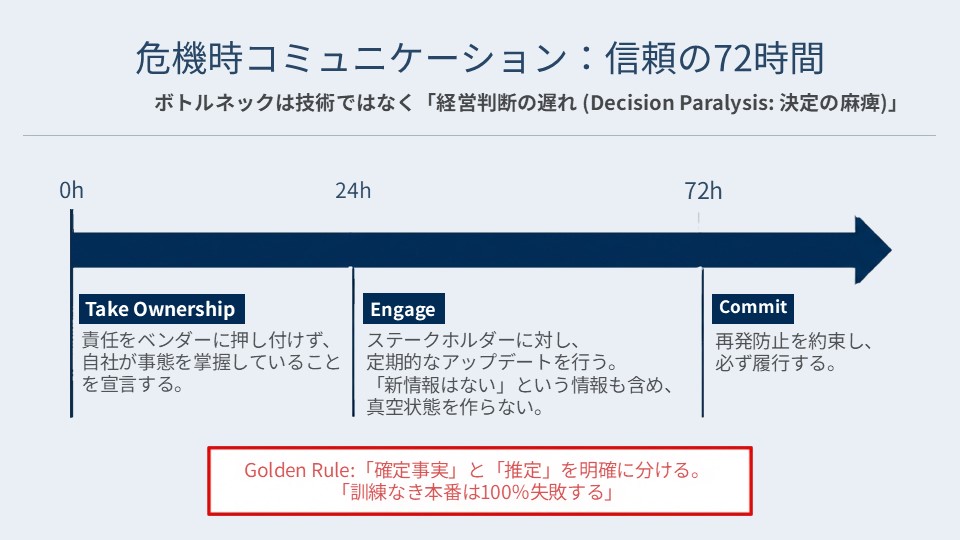

「信頼の72時間」とよく言われていますが、インシデント発生後どれだけ早く対応できるかがサイバーセキュリティ、AIセキュリティの課題であると考えます。(図6)

経営者は「止まらない七つの原則」として、以下を設計しておくことが重要です。

- 原則1:事業継続を最上位目的に置く

- 原則2:例外を資産負債として管理する

- 原則3:代替手段を設計しておく

- 原則4:意思決定のRACIを決める

- 原則5:更新型コミュニケーションにする

- 原則6:第三者リスクを前提にする

- 原則7:事故後に学習する

図6.危機時コミュニケーション:信頼の72時間

ISO/IEC 42001(AIMS)「説明できるAI」を実装する

(1)AIMSとは

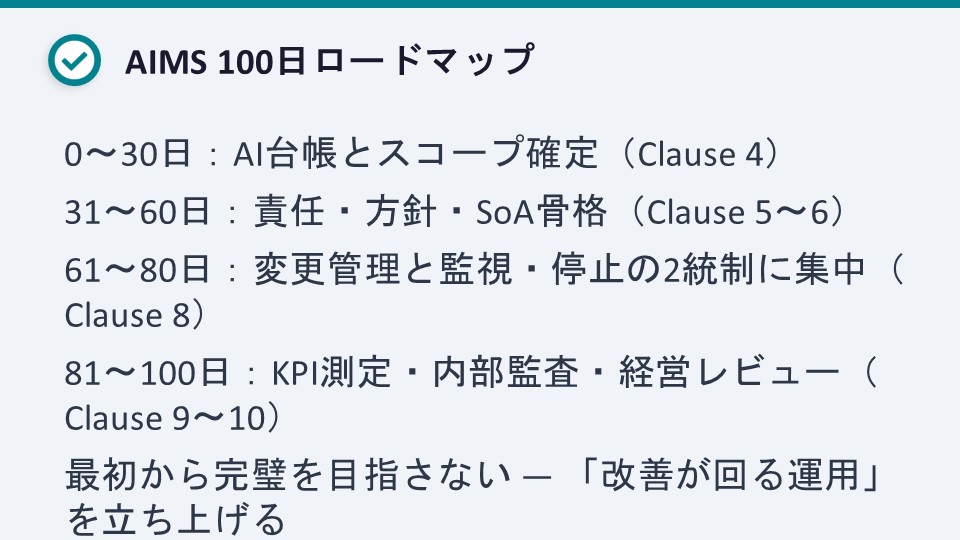

AIマネジメントシステム(AIMS)は、AIを情報セキュリティマネジメントシステム(ISMS)同様の管理対象としてPDCAサイクルを回しながら継続改善していくものです。

- AIを品質(Q)や情報セキュリティ(IS)と同じ管理対象に

- PDCAサイクルで継続的に改善

- Clause 4〜10:範囲→責任→計画→支援→運用→評価→改善

- Annex A:9領域・38の参照コントロール

- SoA(適用宣言書)で説明責任を担保

「AIMS100日ロードマップ」(図7)のように、全体を把握→システムの管理体制を構築→確認→改善する仕組みをどう作るかがポイントとなります。

ここでのポイントは、ISMSとAIMSについて、管理を分断(サイ口化)させず、既存のリスク管理と統合する必要がある点です。後ほどご紹介するMITのCAMSにおいても、AIセキュリティとサイバーセキュリティの一体化について議論が始まっています。

図7.AIMS100日ロードマップ

(2)規制の洪水を「設計」に変える

企業はさまざま規制をいかにきれいにデザインしてまとめていくかが重要ですが、特に重要なのが「三線モデル」という、現場・管理部門・監査の各データを三つのラインで整理し、取締役会では1ページの資料で報告できるように設計することです。複雑なマネジメントを単純化し、かつシンプルにすることが大きな流れとして必要になると言われています。

(3)サイバーAIの文化

サイバーAIの文化として、経営者や従業員の理解、知識の共有が重要であり、自社に限らず、サプライチェーン間で共通した「セキュリティを守る文化」を醸成することが必要になります。

経営には、優先順位をどこに置くかを決め、皆が参加し、知識を共有することが重要で、そのために職務内の安全行動をマニュアル化したり、おかしいと思ったら声を上げる、といった体制を作っていくことが重要です。

CAMSについて

CAMSはマサチューセッツ工科大学(MIT)の経営大学院が行っているプロジェクトで、戦略・ガバナンス・マネジメント・組織の四つの柱をテーマに「経営」がどうあるべきかを研究・発信しています。

日本の企業に対しても経営手法やインシデント発生を想定した体制作りや、ボードメンバーがどうすべきかなどを示唆しています。

CAMSにはさまざま分野の研究者が携わっており、最新のデータや技術をいかに最新の経営に反映させるかまで見ることができ、それが強みでもあります。また、さまざまなインシデントデータも収集しています。これまでの日本語の壁によりサイバーが守られている時代は終わり、外国からの攻撃も増えてくると予想していますので、日本でも役に立つと思っています。

CAMSの議論において、どういう結果をボードメンバーに提示し、どう判断させなければならないかが非常に重要になります。

したがって、AIMSの土台にマネジメントやガバナンスを置いていくことがCAMSやMITの役割だと考えています。

最後に

AIセキュリティ、サイバーセキュリティの課題は経営の設計問題であると考えます。攻撃を受けることを前提に、いかに攻撃で止められる確率を下げるか、止まった場合の復活、レジリエンス強靭化といいますが、レジリエンスをどう作っていくか、攻撃や問題発生後に学習する、といったことをどう設計するかが必要になります。

AIMSの普及によるプラットフォームの確立後、国際動向などを参考にしつつ、さまざまなコンサルティングや社員教育などを付加していくようになるのではないか、と思います。

本内容は、2026年3月30日から4月20日にかけてオンデマンド配信されたJIPDECセミナー「AIのリスクマネジメントとAIマネジメントシステム(AIMS)認証の最新動向」での講演内容を取りまとめたものです。

マサチューセッツ工科大学サイバー・AIセキュリティマネジメントコンソーシアム(CAMS) 副統括責任者

慶應義塾大学 特任教授

ミュンヘン工科大学AI倫理研究所客員教授

藤末 健三氏

MITビジネススクールのサイバー・AIセキュリティマネジメントコンソーシアム(CAMS)アソシエイト・ディレクター(副統括責任者)。

ミュンヘン工科大学AI倫理研究所客員教授

慶應義塾大学 特任教授、インド工科大学ハイデラバード校特任教授、韓国先端科学技術院特任教授、オックスフォード大学インターネットインスチチュート前上級客員研究員など、国際的な研究ネットワークを構築。

MITスローン経営大学院およびハーバード・ケネディスクールで修士学位を取得。早稲田大学および東京工業大学で博士号を取得。

学術・政治活動に加え、プロボクサーライセンスを保持し、現在もトレーニングを継続