2026.05.12

レポート

ISO/IEC 42001 認証事例紹介 「AIMSを通じたAIガバナンスの「実装」」

株式会社Godot 共同創業者、CTO(Chief Technology Officer) 鈴井 豪氏

はじめに

株式会社Godot(以下、弊社)は2022年創業のスタートアップ企業で、行動科学や人の意思決定にかかわる部分、主に企業が顧客に対しウェルビーイングを高めてもらうために行っている施策をより効果的、効率的にするためのAIシステムを提供しています。たとえば、自治体が市民に健康診断受診を促す施策や企業の福利厚生の活用に向けた施策の立案などをAIで支援するなどのサービスを提供しています。

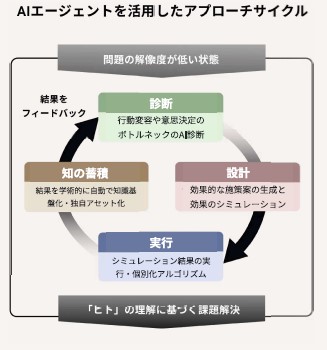

人の行動変容を促す場合、AIを使って現状把握とどう変えればよいかを診断し、どのような施策が適当かAIで提案、シミュレーションにより効果を予測し、どういうアイデアがベストなのかを比較検討し、その結果をもとに本当のフィールドで実装実証を行います。その結果をもとに次の施策にも活かせるようにする、という一連のフィードバックを一つのAIシステムとして完結させて提供しています。(図1)

図1.AIエージェントを活用したアプローチサイクル

AIMS認証取得に至った理由

弊社は2025年4月に国内初のISO/IEC 42001(AIマネジメントシステム:AIMS)認証を取得しました。

創業当初から技術開発時に三つのメインテーマを掲げています。

- ソーシャルテクノロジーで社会に貢献する技術を作る

- トランスペアレンシー(透明性の担保)で社会をよりよくする

- 特定の人向けだけでなく、インクルーシビリティ(より包摂的)なAIシステムを作る

これらのテーマのもと、社内でシステムやガバナンスを整備していましたが、第三者認証による客観的な評価を得るため、AIMSの国内最初の認証取得を目指し、体制構築に着手しました。

AIMSのリスクベースアプローチ

AIMSを考える際、「AI事業者ガイドライン」1(経済産業省/総務省)や「行政の進化と革新のための生成AIの調達・利活用に係るガイドライン」2(デジタル庁)、弊害リスクを包括的にまとめた「The AI Risk Repository」3(MIT)でAIの持つリスクをどう捉えるか、どのような種類のリスクがあるか参考にしつつ、AI方針の立て方やAIリスクの捉え方などを構築していきました。また、最新のAIインシデントが検索できるMITの「AIインシデントデータベース」4も大変参考になりました。

最近のAIは技術進化が著しく、同時に新しい技術が生まれ、認識できていなかったAIの潜在的リスクが同時に顕在化することもあるため、最新のインシデントを把握しておくことはAIガバナンス上重要と考えています。

自社で認識していなかったAIリスクが発生した場合はそのリスクを調査し、自社に当てはまるかをチェックするなど行っていましたが、最新情報を積極的に収集する作業はかなり多く発生しました。今回ご紹介した各資料はAIMS運用やAIリスク把握の参考になりますので、ご活用ください。

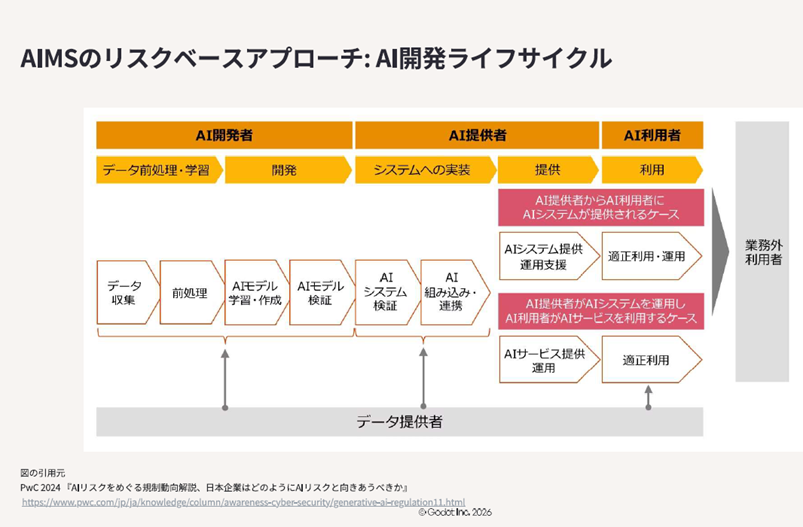

1.AIMSのリスクべ—スアプローチ:AI開発ライフサイクル

AIシステムは図2のような開発ライフサイクルで開発します。

図2.AIMSのリスクベースアプローチ:AI開発ライフサイクル

開発ライフサイクルの中でリスクを洗い出す場合、漠然とリスクを考えるのではなく、それぞれのステージでどのようなリスクが潜在しているかを考える必要がありました。データ汚染やバイアスが強いデータが含まれていれば、それに基づいて学習したモデルにも偏りが生じるため、事前の検証が不可欠です。またデータの前処理段階での誤り、たとえば個人情報が含まれていたり、マスキングに不備がないか、またモデル学習過程で一部の人にとって好ましくない結果が出てしまわないように検証しているか、なども重要な検討事項です。

AIシステムに限ったことではありませんが、ITソフトを提供する際には、外部環境や周辺IT環境によるシステムの誤作動が起きないよう、定期的な測定も必要になります。その測定を怠ったことがリスクにつながるかの確認も必要です。また、開発ライフサイクルの最後のフェーズであるシステム提供後、企業が想定しない使い方をしていないか、といったリスクヘッジを行っておくことも必要です。

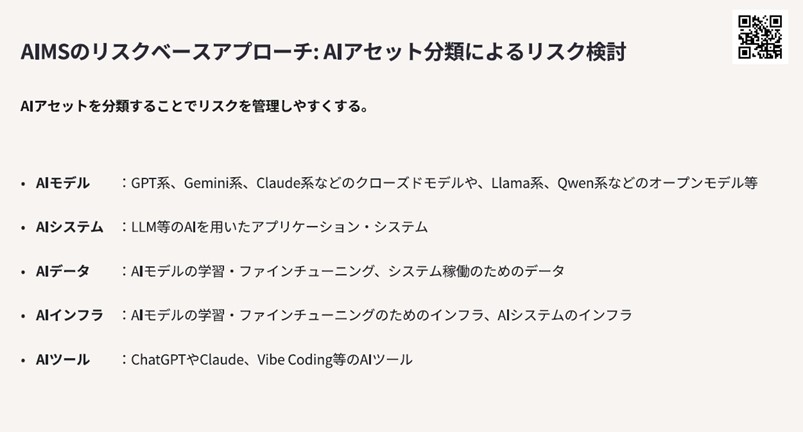

2.AIMSのリスクべ—スアプローチ:AIアセット分類によるリスク検討

別のリスクベースアプローチとして、図3のようにAIアセット(情報資産)別にリスクを考える方法もあります。

図3.AIMSのリスクベースアプローチ:AIアセット分類によるリスク検討

どのようなリスクが潜在しているか、システムに載せたときにどういうリスクが発生するか、などをそれぞれのアセットごとに考え、なるべく漏れがないようにする、ということも考えました。このような検討の際にもAI事業者ガイドライン等、先ほど紹介した資料を参考にリスクの洗い出しを行いました。

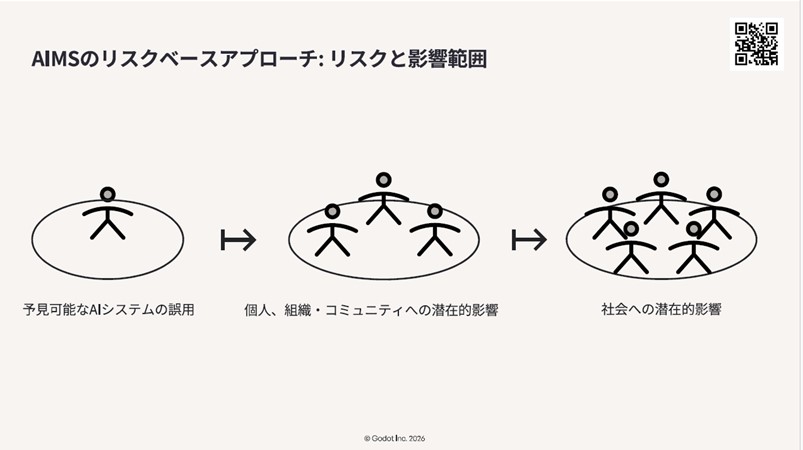

3.AIMSのリスクベースアプローチ:リスクと影響範囲

リスクの考え方として三つのフェーズで考えなければなりません。(図4) たとえばうっかり個人情報を入れてしまうなどのシステムの誤用リスク(フェーズ1:予見可能なAIシステムの誤用)から会社の機密情報や個人情報の漏えいにつながり(フェーズ2:個人、組織・コミュニティへの潜在影響)、このような影響が重なることで生成AIに対する懐疑的な世論や社会的動向(フェーズ3:社会への潜在的影響)につながってしまうというリスクがあることをAIMS運用上で考え、事例や資料を参考にリスクを洗い出していきました。

図4.AIMSのリスクベースアプロ—チ:リスクと影響範囲

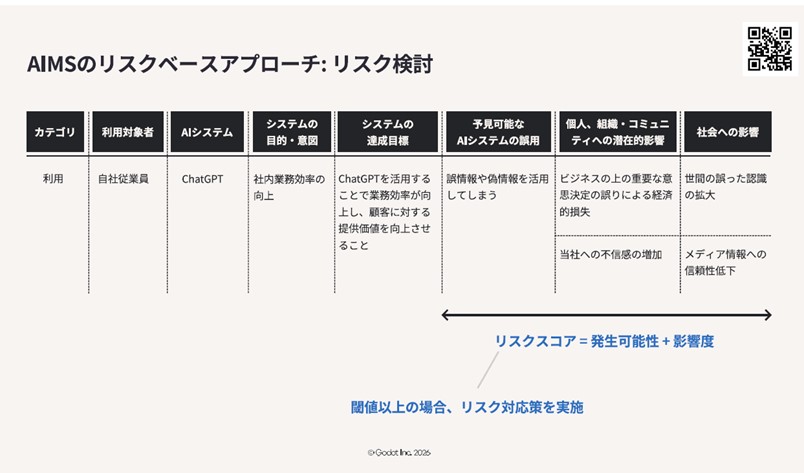

リスク検討方法について具体的に紹介すると、図5のように「カテゴリ」から「社会への影響」それぞれについてどんな影響があるか、どのようなリスクが潜在しているか等を洗い出し、リスクの発生可能性と影響度をスコアリングし、あらかじめ設定していた閾値以上の場合にリスク対策を実施することを繰り返し行っていきます。

リスク対策を考える場合、技術に限らず組織としてどうあるべきかが重要になってくるため、組織としてどうリスクヘッジしていくか、どう回避すればよいか、需要につながるかといったことも考えます。なお、リスク検討時には専門外の領域についての検討も含まれていたので、先に紹介したMITの資料などを積極的に活用し、自社にあったリスク対応を検討・実行していきました。

図5.AIMSのリスクベースアプローチ:リスク検討

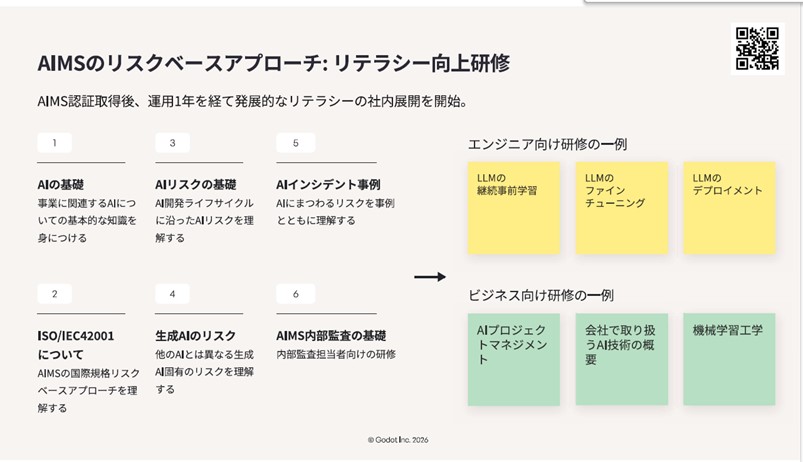

4.AIMSのリスクベースアプローチ:リテラシー向上研修

AIMS運用上、管理対象となる従業員のリテラシーが重要な観点となります。AIリスクそのものを認知できなければリスク対応ができないため、まずは認知する能力を高める必要があります。そのため弊社では新規のメンバーにAI教育コンテンツの受講やAIMS規格内容、AIリスクやAIインシデント事例などを習得してもらい、メンバー全員での共通ナレッジを作り、その後に発展形としてエンジニア向け、ビジネス向けなど、立場に特化した研修を行い、その中でさらに議論していくなど、全社としてリテラシー向上を図っています。(図6)

図6.AIMSのリスクベースアプローチ:リテラシー向上研修

AIMSの効果

AIMS運用により、自社では以下の三つの効果が確認されました。

●倫理的思考の文化醸成

全社的に教育やリスクに対し取り組むことで、なぜ必要なのかといった倫理的な思考が高まっていきました。

●問い続ける力の育成

AIはどう動いているのか、どんなリスクがあるのか、といった点を問い続けていく力が育まれてきました。

●自律的判断・対応力

メンバー一人ひとりがある程度AIリスクがどういうものか、どう対応すべきかを自律的に判断、対応する力を身に着けてもらえました。

これらの効果によりAIMS委員会のみならず全社的にAIMSを進めていく形になりました。

AIによるAIガバナンスの強化

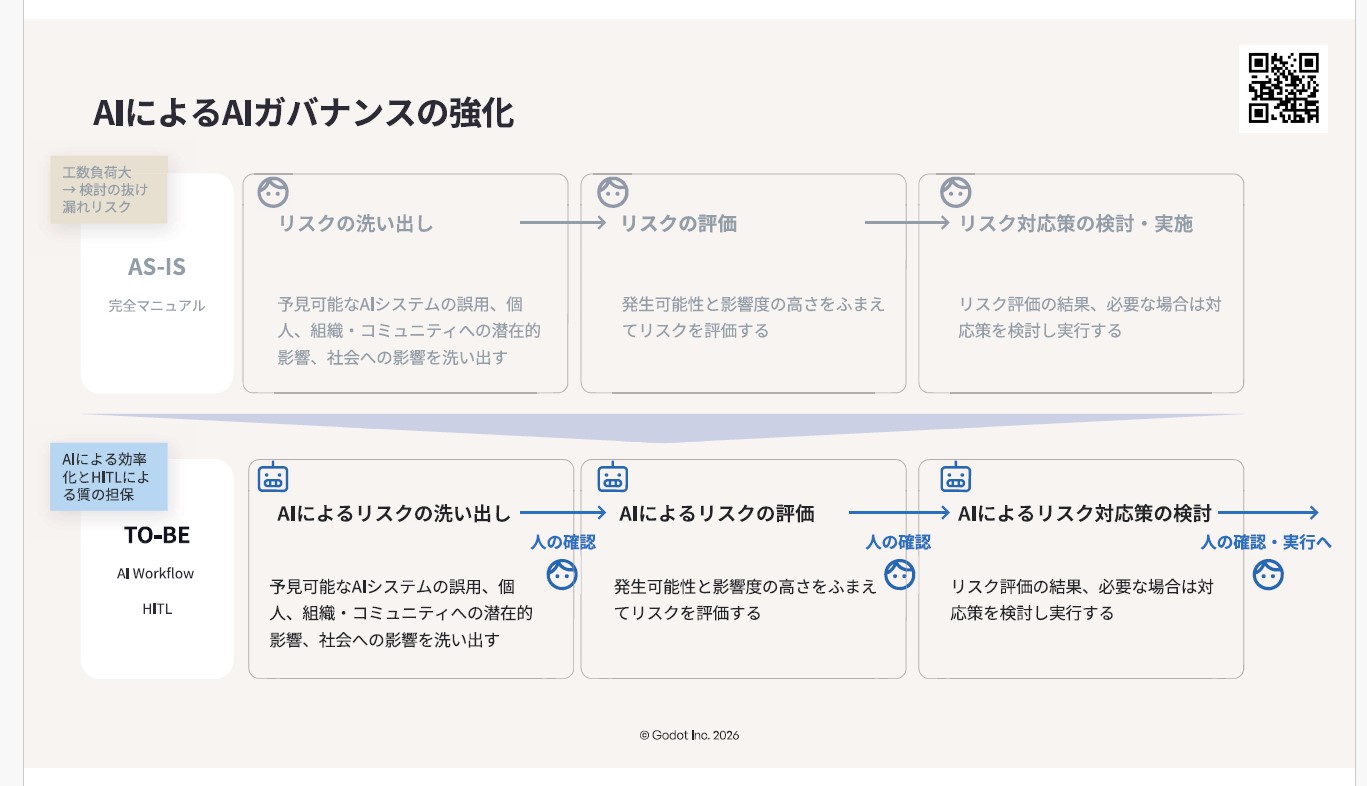

AIMS運用は実施内容やAIリスクの洗い出しがたくさんあるため、かなり大変な作業となります。弊社の場合、複数のAIモデルを組み合わせて一つのシステムとして提供しており、AIモデルとして多くの種類を管理しています。人力で処理するには工数も多くなることから、図7のように新しいAIリスクの洗い出し、評価、対応策の検討・実施の過程において、AIを活用しその結果を人間がチェックして先に進める、という形をとっています。特に工程が多い場合は人間とAIが共同(ヒューマン・イン・ザ・ループ)して工程負荷を下げることでより効率的に、またAIリスク漏れの軽減につながると考えており、AIを使ってAIガバナンスを強化しています。

図7.AIによるAIガバナンスの強化

本内容は、2026年3月30日から4月20日にかけてオンデマンド配信されたJIPDECセミナー「AIのリスクマネジメントとAIマネジメントシステム(AIMS)認証の最新動向」での講演内容を取りまとめたものです。

株式会社Godot 共同創業者、CTO(Chief Technology Officer)

鈴井 豪氏

カリフォルニア大学バークレー校大学院でデータサイエンスを研究した後、国内のGovTechスタートアップに参画。チーフ・データサイエンティストを務めたのち、株式会社Godotを共同創業し、CTOに就任。その後、日本のスタートアップとして初めてオーストリア・ウィーンの子会社 Godot GmbH の設立を主導し、現地代表に就任。ヨーロッパにおける共同プロジェクトの推進や補助金の獲得、AI Act対応を牽引したのち帰国。この間、米国ジョージア工科大学大学院にて大規模言語モデルやAIエージェントを研究。帰国後は、日本初となるAIマネジメントシステムの国際認証 ISO/IEC 42001 の取得を主導。同社CTOとして、AIプロジェクト全体の統括とAIリスク管理を担う。